Einführung

OpenAI Whisper zeichnet sich darin aus, Sprache aus verschiedenen Mediendateien, einschließlich Audio- und Videodateien, in geschriebenen Text umzuwandeln. In diesem Tutorial werden Sie durch die grundlegenden und fortgeschrittenen Anwendungen des Whisper-Befehls geführt, um hochgenaue Transkriptionen zu ermöglichen.

Beherrschen von Whisper für die Medientranskription

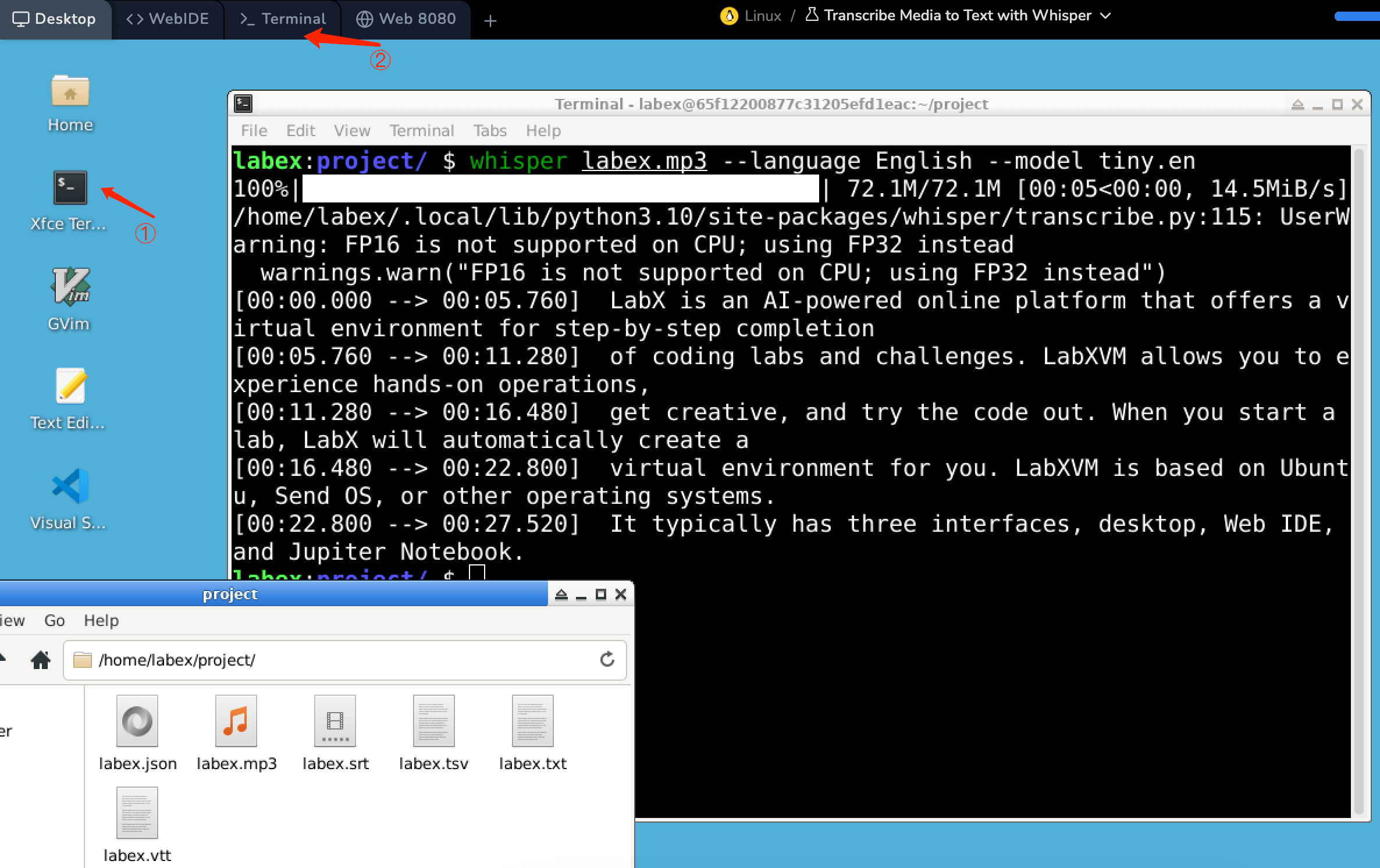

Es gibt eine Audio-Datei labex.mp3 in /home/labex/project. Öffnen Sie das Terminal ( ① oder ② in der Abbildung ) in der Umgebung und geben Sie den folgenden Befehl ein:

whisper labex.mp3 --language English --model tiny.en

In diesem Befehl wird whisper angewiesen, die Mediendatei labex.mp3 zu transkribieren.

- Der Parameter

--languageist auf Englisch eingestellt, was die Sprache angibt, die in der Mediendatei gesprochen wird. - Die Option

--modelwählt das Whisper-Modell aus, das verwendet werden soll.tiny.enist ein kleineres, schnelleres Modell, das für die englische Sprache optimiert ist und sich für schnelle Aufgaben oder weniger leistungsstarke Hardware eignet.

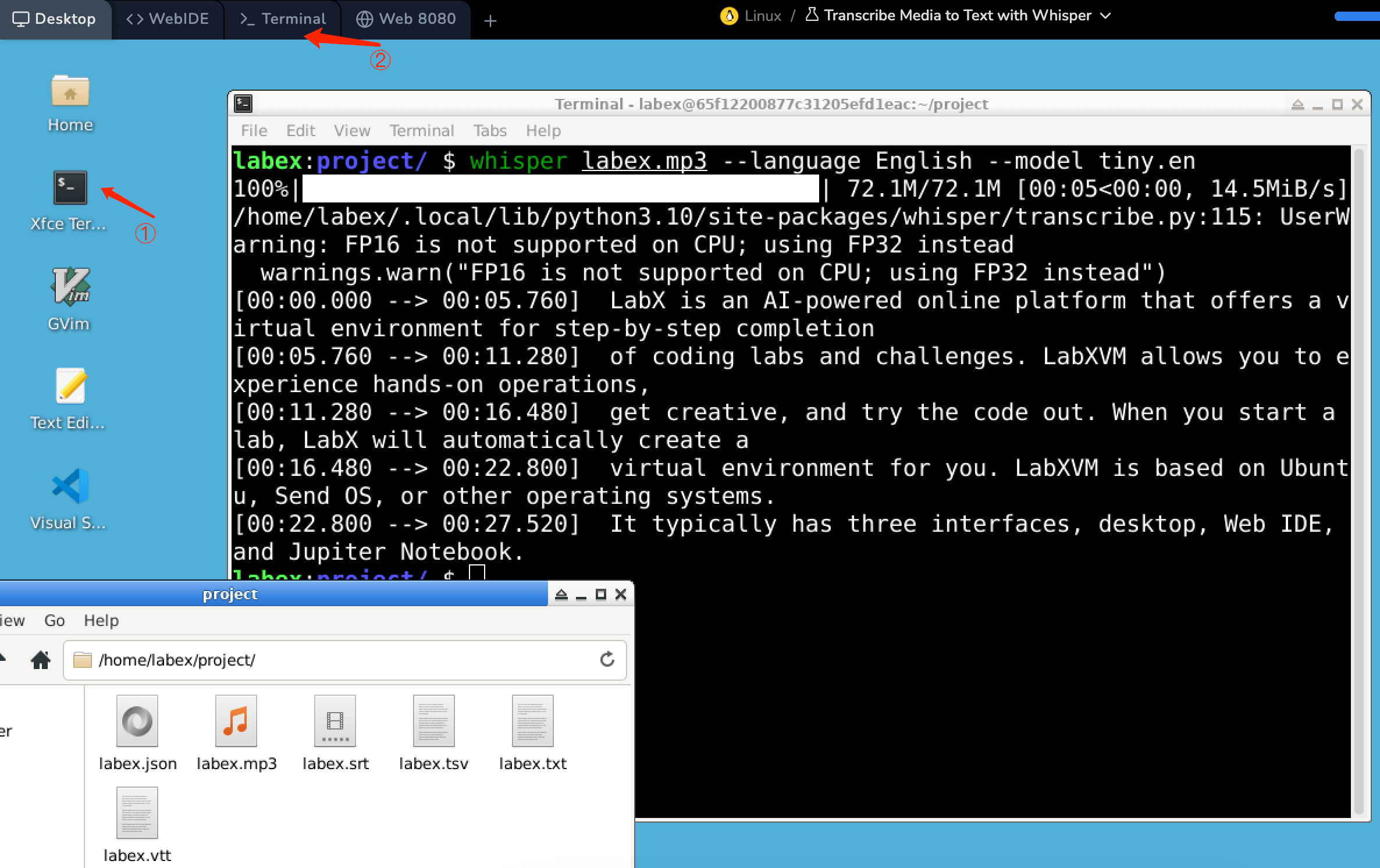

Nach der Ausführung des Whisper-Befehls zur Transkription von Mediendateien können mehrere Dateien in /home/labex/project generiert werden, die jeweils einen bestimmten Zweck und Format für den transkribierten Text haben. Hier ist eine Übersicht über die einzelnen Dateitypen:

- output.json: Diese Datei enthält die detaillierten Transkriptionsergebnisse im JSON-Format, einem leichtgewichtigen Datenaustauschformat, das für Menschen einfach zu lesen und zu schreiben und für Maschinen einfach zu analysieren und zu generieren ist. Die JSON-Datei enthält nicht nur den transkribierten Text, sondern auch zusätzliche Metadaten wie Zeitstempel, Zuverlässigkeitswerte und möglicherweise Sprecheridentifikationen. Dieses Format ist besonders nützlich für Anwendungen, die eine detaillierte Verarbeitung oder Analyse der Transkriptionsergebnisse erfordern, wie z. B. für die Erstellung von Untertiteln mit genauen Zeitangaben oder für die Analyse von Sprachmustern.

- output.srt: Das SRT (SubRip Subtitle)-Format wird zur Darstellung von Untertiteln verwendet. Jeder Eintrag in einer SRT-Datei besteht aus einer Sequenznummer, dem Zeitraum, in dem der Text angezeigt werden soll, und dem Text selbst. SRT-Dateien werden von vielen Videowiedergabesoftware und -plattformen unterstützt, was dieses Format ideal für das Hinzufügen von Untertiteln zu Videos macht.

- output.tsv: TSV steht für Tabulator-getrennte Werte. Dieses Format ähnelt dem CSV-Format (Komma-getrennte Werte), verwendet jedoch Tabulatoren als Trennzeichen zwischen den Datenfeldern. Eine

output.tsv-Datei von Whisper könnte den transkribierten Text zusammen mit Zeitangaben und Zuverlässigkeitswerten enthalten, getrennt durch Tabulatoren. Dieses Format kann für Datenanalyseaufgaben oder für das Importieren der Transkriptionsergebnisse in Datenbanken oder Tabellenkalkulationen nützlich sein. - output.txt: Dies ist eine einfache Textdatei, die nur den transkribierten Text ohne Zeitstempel oder Metadaten enthält. Die Einfachheit dieses Formats macht es für Anwendungen geeignet, bei denen der Inhalt des Texts wichtiger ist als die Zeitangabe oder bei denen der Text von Menschen oder einfacher Textverarbeitungssoftware gelesen oder verarbeitet werden muss.

- output.vtt: VTT (Web Video Text Tracks) ist ein weiteres Untertitelformat, das dem SRT-Format ähnelt, aber mehr Funktionen bietet. Es ist das Standardformat für Untertitel im HTML5-Video-Tag und unterstützt die Formatierung und Positionierung von Untertiteln. Das VTT-Format ist besonders nützlich für Web-Videoinhalte, da es ein reichhaltigeres Anschauungserlebnis mit anpassbaren Untertiteln ermöglicht.

Jede dieser Dateien erfüllt verschiedene Anwendungsfälle, von einfachen Textdokumenten bis hin zu detaillierten Analysen oder Videountertiteln, und bietet somit Flexibilität bei der Nutzung der Transkriptionsergebnisse.

Zusammenfassung

In diesem Tutorial haben Sie gelernt, wie Sie OpenAI Whisper verwenden, um Inhalte aus Mediendateien in Text zu transkribieren. Wir haben mit den Grundlagen begonnen und gelernt, wie man eine einfache englische Mediendatei transkribiert. Anschließend haben wir fortgeschritten und zusätzliche Funktionen zur Optimierung des Transkriptionsprozesses erkundet, wie z. B. die Auswahl verschiedener Modelle und die Batch-Verarbeitung. Whisper zeichnet sich als vielseitiges Tool aus, mit dem Sie mühelos eine Vielzahl von Mediendateien transkribieren können.